冻结大语言模型隐藏状态中仍存可读行为信号,新技术大幅提升准确性

作者:Rohan Paul / @rohanpaul_ai

发布时间:2026-05-07T19:22:58.000Z

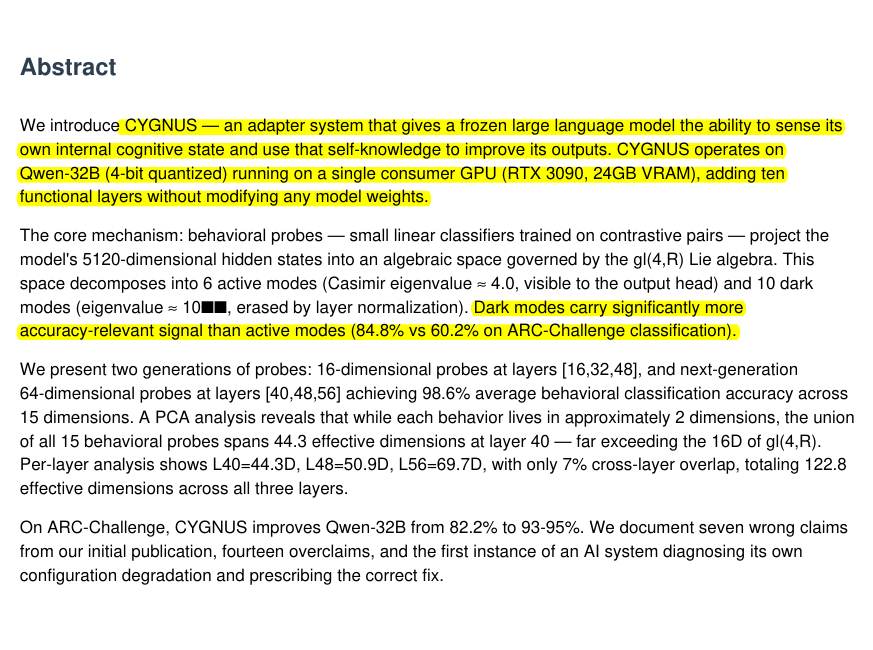

Frozen LLMs still carry readable behavior signals deep inside their hidden states.

And Proprioceptive AI has created Cygnus, that lets LLMs sense their own internal thinking patterns and dramatically improve accuracy.

This pushes Qwen-32B from 82.2% to 94.97% on ARC-Challenge https://t.co/5InmNuUMpV